인공지능이 인간의 일자리를 점령할 거라는 예측이 심심찮게 쏟아지는 요즘입니다. 인공지능이 스스로 학습하면서 각각의 전문 분야에서 두각을 드러내고 있는데요.

세상 모든 걸 컴퓨터가 다 해결할 수 있을 것만 같지만, 그 뒤에는 엔지니어들의 땀나도록 투입된 노력이 존재합니다. 컴퓨터는 곧이 곧대로 '시키는 것'만 잘 하는 녀석이기 때문인데요. 컴퓨터에 '무엇을, 어떻게' 시켜야 하는지를 결정하는 건 결국 인공지능 엔지니어들의 역량에 달렸습니다.

여기에서 일반인은 전혀 예상하지 못하는 고통이 있다고 합니다. <이웃집과학자>는 LG이노텍에서 인공지능을 이용한 '육계 스마트팜' 연구를 하고 있는 신제용 선임의 도움을 받아 인공지능 엔지니어의 '숨은 고충'을 다뤄봤습니다.

머신러닝의 발전, 인공지능의 시대

요즘은 인공지능의 시대라고 해도 과언이 아닙니다. 이런 시대가 도래한 가장 큰 원동력으로 '머신러닝(machine learning)'을 빼놓을 수 없는데요. 쉽게 말하면 인공지능이 뭔가를 '알아서 배우는' 작업이 가능해졌습니다.

머신러닝을 이해하기 위해 어린 아이들을 가르치는 장면을 떠올려볼까요? 그림카드 들고 하나씩 '고양이', '강아지'라고 알려줍니다. 실제 고양이를 보고 "고양이다!" 말한 아이에게는 칭찬해 줍니다.

'머신러닝' 시대가 도래하며 컴퓨터에게도 이 같은 방법을 사용할 수 있게 됐습니다. 머신러닝 기반으로 '고양이를 찾는 인공지능'을 만든다고 하면, 고양이가 뭔지 컴퓨터가 '배우도록' 한 뒤 실제 고양이 사진을 주고 찾아낼 수 있는지까지 확인합니다. 인공지능이 학습하는 방법은 아이들의 학습과 상당히 비슷합니다.

머신러닝 이전의 컴퓨터 비전(vision) 알고리즘들은 컴퓨터에 각각의 조건을 알려주는 방법으로 일을 시켰습니다. 사진에서 고양이를 찾아내는 프로그램을 만들기 위해서는 고양이의 조건을 일일히 줬어야 합니다.

예를 들어 얼굴 대 눈의 반지름은 3:1, 귀 끝의 각도가 30~45˚, 등등의 조건들을 입력한 후 고양이 사진을 입력하고 컴퓨터가 찾을 수 있는지 알아봅니다. 만약 잘 찾지 못한다면 귀 끝의 각도가 안보이는 사진은 어떻게 처리할지 각각의 조건을 다 알려줘야 했죠. 그림 카드를 보여주며 '고양이'라고 알려주는 아이들 교육 방법과는 차이가 있었습니다.

머신러닝은 아이들에게 그림카드를 주듯, 컴퓨터에 고양이가 있는 사진과 고양이가 없는 사진을 주면서 '이건 고양이가 있는 사진이야', '이건 고양이가 없는 사진이야'를 알려줍니다. 그리고 컴퓨터가 그 차이를 '알아서' 터득하도록 합니다. 초기 머신러닝인 '쉘로우 러닝(Shallow learning)'에서는 '고양이 귀의 각도를 보고 구별해봐'라는 지시를 했지만 '딥러닝(deep learning)' 시대가 도래하며 어떤 부분에 주목해야 할지 까지도 컴퓨터가 알아서 결정합니다.

그러면 덕분에 편해진 거 아냐?

그러면 엔지니어가 그다지 큰 수고를 들이지 않아도 되는 게 아니냐고 묻는 분들이 있을텐데요. 문제는 고양이 사진, 혹은 그림 하나만 보여주면 온 세상 고양이를 다 알아보는 아이들과는 달리, 컴퓨터는 그렇지 못하다는 점입니다.

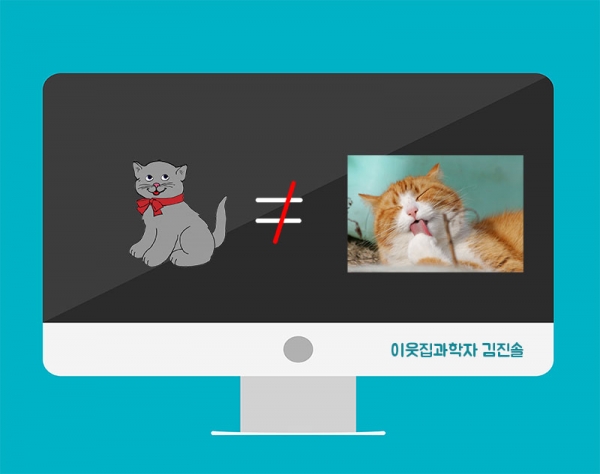

따져보면 이해가 갑니다. 이 그림에서 보듯, 그림 카드에 있는 회색 고양이와 누워서 눈을 감고 혀를 내밀고 있는 노란 줄무늬 고양이는 하나하나 따져보면 비슷한 점이 별로 없습니다.

따라서 인공지능을 가르치려면 '다양한' 형태의 고양이 사진이 '많이' 필요합니다. 컴퓨터에 고양이가 있는 사진을 주며 '여기 고양이가 있다'고 알려줍니다. 동시에 고양이가 없는 사진을 보내주며 '여긴 고양이가 없다'고 알려줍니다. 몇 장이나 줘야 하냐고요? '머신러닝'의 시대에는 수백, 혹은 수천장의 고양이 사진이 필요했습니다. 그 '알려주는' 작업은 전적으로 인간의 몫이죠.

날이 갈수록 이 '노역'은 강도를 더합니다. 그 이유는 머신러닝의 한 갈래인 '딥러닝(deep learning)'이 발전했기 때문입니다. 딥러닝에서는 머신러닝보다 훨씬 더 많은 데이터를 이용해 학습 할 수 있게 됐습니다. 즉, 다다익선입니다. 연구자는 때로 수만장의 사진을 구해다가 컴퓨터에 바쳐야 하죠.

자료만 준다고 끝난 게 아냐

사진만 줘서 될 문제였다면 그나마 다행이었을 겁니다. 많은 경우 더 '손을 본 교육자료'가 필요합니다. 예를 들어 사진마다 고양이가 몇 마리가 있다는 정보를 줘야 할 수도 있습니다. 혹은 고양이가 '여기 있다'는 정보를 주기 위해 고양이에 수십개의 점을 찍어서 줘야 할 수도 있습니다.

이렇게 수십장을 줬는데도 컴퓨터가 대상을 잘 찾지 못한다면 자료를 더 많이 넣어주거나 학습자료를 다르게 만들 방법을 생각해봐야 합니다. 최악의 경우 고양이 털 하나하나까지 자세히 색칠해서 줘야 할 수도 있습니다.

이렇게 입력하고 고양이의 사진을 찾는 방향으로 학습시키면 컴퓨터는 고양이를 찾을 수 있게 됩니다.

학습 방법도 나날이 발전하고 있습니다. 적대적 생성모형(GAN)등 다양한 방법이 나와있는데요. <이웃집과학자>의 이전 콘텐츠에서도 알려드린 적 있으니 아래 링크를 참고하세요!

LG이노텍에서 인공지능을 이용한 '육계 스마트팜' 연구를 하고 있는 신제용 선임은 <이웃집과학자>와의 인터뷰에서 "딥러닝 기반 인공지능에게 쓸 '교육자료 제작' 때문에 굉장한 고생을 한 적 있다"고 말했는데요. "이틀 내내 CCTV로 찍은 양계장 영상을 보며 닭을 하나하나 픽셀 단위로 체크한 적이 있다"며 "집에 오니 마우스를 잡았던 손이 퉁퉁 부어 있었다"고 증언했습니다.

인공지능, 일을 잘 처리하고 있긴 한데, 어떻게 하는지는 모른다

한편, 머신러닝 알고리즘에서 난감한 점이 있습니다. 컴퓨터가 어떻게 고양이를 구분하는지 알 수 없다는 점입니다. 사람처럼 큰 눈, 뾰족한귀, 꼬리를 보고 구분하는지, 아니면 우리는 전혀 눈치채지 못했던 독특한 부분을 보고 구분하는지 알 수 없습니다. 따라서 요즘은 중간 과정을 알아낼 수 있는 'eXplainable AI (XAI)'라는 방법이 새로 떠오르고 있다고 합니다.

인공지능은 이제 거의 모든 분야에서 쓰입니다. 위의 예시처럼 영상을 분석할 때 쓰이기도 하고, 목소리를 만들거나 그림을 그리고 시나 소설을 쓰기도 합니다. 이 모든 일을 컴퓨터가 다 하는 것처럼 보이지만 그렇지 않다는 점, 이를 위해 인공지능 엔지니어들이 그 뒤에서 맹렬히 머리를 쓰고 몸을 움직인다는 점도 떠올려보면 어떨까요?